Нейросети не рождаются умными – их обучают. Каждый раз, когда GPT отвечает на вопрос, а алгоритм распознает ваше лицо на фото, за этим стоят конкретные математические методы. Если вы запускали нейросеть через Keras и хотите улучшить ее с помощью сервера для ИИ, но не до конца понимаете, как она на самом деле учится, – эта статья для вас. Разберем 5 ключевых алгоритмов обучения нейросетей простыми словами: без лишней математики, с аналогиями и примерами.

Содержание:

- Что значит «обучить» нейросеть

- 3 главных подхода к обучению нейросетей

- 5 основных алгоритмов обучения нейросетей

- Переобучение: главная проблема и как с ней бороться

- Основные методы регуляризации

- Как выбрать алгоритм обучения: практические советы

Что значит «обучить» нейросеть

Представьте первоклассника, которому дают задачи на сложение. Он решает, учитель проверяет и указывает на ошибки. Ребенок корректирует подход – и с каждым примером ошибается все реже. Обучение нейросети работает ровно по той же схеме, только вместо школьника – математическая модель, а вместо учителя – алгоритм.

Внутри нейросети есть веса – числовые параметры, которые определяют, насколько сильно один нейрон влияет на другой. В начале обучения веса задаются случайно. Задача алгоритма – постепенно подобрать такие значения весов, при которых сеть дает правильные ответы.

Чтобы понять, насколько ответ неправильный, вычисляется функция потерь – число, которое показывает расстояние между тем, что сеть предсказала, и тем, что должно быть на самом деле. Чем оно меньше – тем лучше обучена модель.

Функция потерь (loss function) – метрика ошибки модели. Если сеть предсказала вероятность «кошка» = 0,2, а правильный ответ – 1,0, функция потерь зафиксирует это отклонение и передаст его алгоритму для корректировки весов.

Один полный проход по обучающим данным называется итерацией (или эпохой). Обычно нейросеть проходит сотни и тысячи итераций, прежде чем достигает приемлемой точности.

Почему нельзя просто запрограммировать все правила вручную? Потому что для задач вроде распознавания речи или перевода текста таких правил буквально миллиарды – человек физически не может их формализовать. Обучение позволяет сети самой вывести эти закономерности из данных.

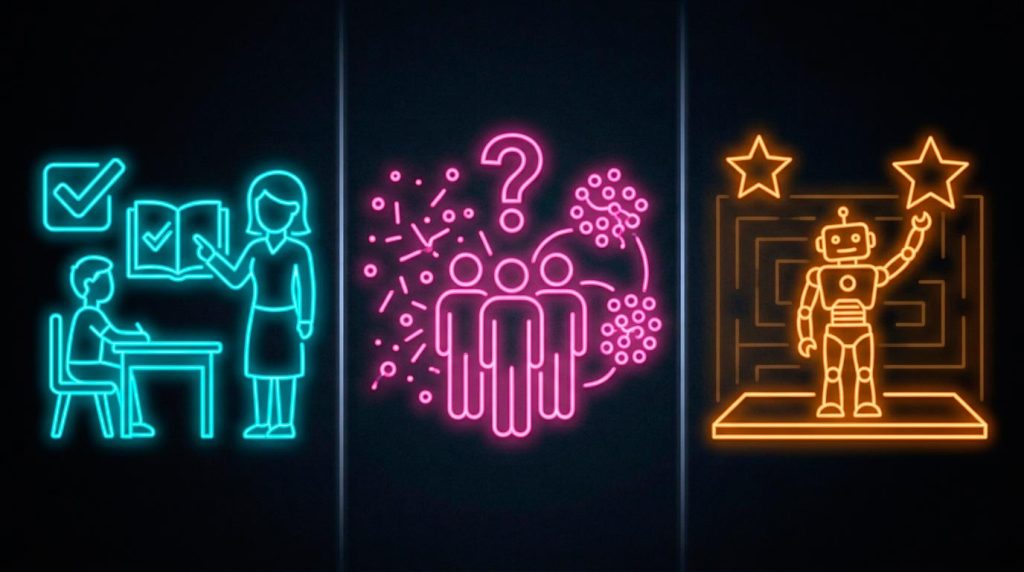

3 главных подхода к обучению нейросетей

Прежде чем переходить к конкретным алгоритмам, важно понять: существуют три принципиально разных способа организовать сам процесс обучения. Они отличаются не математикой, а тем, какие данные подаются на вход и как сеть получает обратную связь.

Обучение с учителем (Supervised Learning)

Самый распространенный подход. Модели дают набор размеченных данных: каждый пример уже снабжен правильным ответом. Сеть учится сопоставлять входные данные с нужными метками.

Пример: вы показываете нейросети 100 000 фотографий и к каждой прикладываете подпись – «кошка» или «не кошка». Сеть учится на этих примерах, а потом классифицирует новые фото, которых раньше не видела.

Применяется в задачах классификации, регрессионного анализа и распознавания речи – везде, где ответ заранее известен хотя бы для части данных.

Обучение без учителя (Unsupervised Learning)

Здесь меток нет совсем. Нейросеть получает «сырые» данные и должна самостоятельно найти в них структуру, группы или закономерности.

Пример: интернет-магазин загружает данные о поведении миллиона покупателей без каких-либо подписей. Алгоритм сам выделяет кластеры: «покупают дорогое и редко», «покупают дешево и часто», «смотрят, но не покупают». Маркетолог потом использует эти группы для точечных рассылок.

Применяется в кластеризации, снижении размерности данных и выявлении аномалий.

Обучение с подкреплением (Reinforcement Learning)

Данных нет вообще – есть среда, действия и обратная связь в виде наград или штрафов. Агент (нейросеть) пробует разные действия и обучается максимизировать суммарное вознаграждение.

Пример: именно так обучался AlphaGo – не на правилах, а на миллионах партий против самого себя. Победа – награда, проигрыш – штраф. Со временем агент выработал стратегии, которые удивили профессиональных игроков.

Применяется в робототехнике, автономном вождении и обучении игровых агентов.

Сравнение подходов обучения:

| Критерий | С учителем | Без учителя | С подкреплением |

| Тип данных | Размеченные | Неразмеченные | Нет данных – есть среда |

| Принцип работы | Сравнение с правильным ответом | Поиск структуры в данных | Награды и штрафы за действия |

| Типичные задачи | Классификация, регрессия | Кластеризация, сжатие | Игры, роботы, авто-пилот |

| Пример | Распознавание спама | Сегментация клиентов | AlphaGo, робот-манипулятор |

Как нейросеть учится на ошибках: обратное распространение

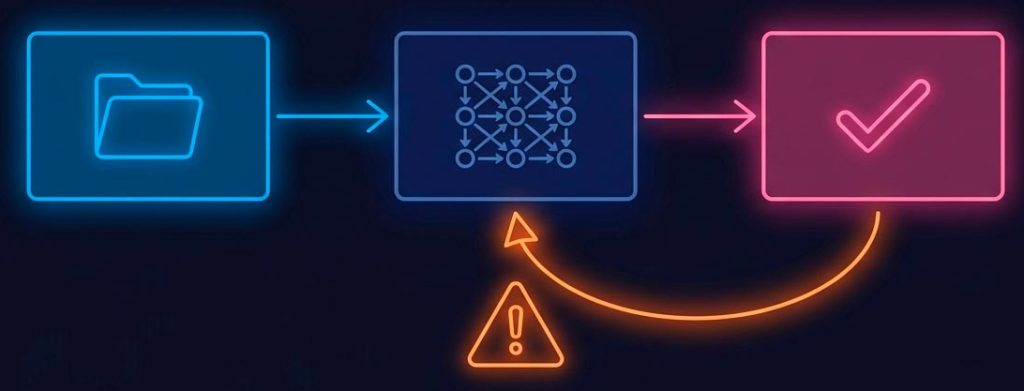

Методы обучения описывают, что подается на вход. Но как именно сеть исправляет свои ошибки внутри – это отдельный механизм, который называется обратным распространением ошибки (backpropagation). Он лежит в основе практически всех алгоритмов, о которых пойдет речь дальше.

Аналогия: представьте цепочку из пяти менеджеров, которые передают друг другу задание. Финальный отчет оказался неверным. Руководитель не просто ругает последнего в цепочке – он разбирается, на каком именно звене произошла ошибка и насколько каждый менеджер в нее «вложился». Именно так метод обратного распространения ошибки распределяет ответственность между слоями нейросети.

Процесс выглядит так:

- Прогноз: нейросеть обрабатывает входные данные и выдает предсказание (прямой проход).

- Ошибка: функция потерь сравнивает предсказание с правильным ответом и вычисляет величину расхождения.

- Градиент: алгоритм вычисляет, как именно изменение каждого веса влияет на ошибку – в каком направлении и насколько сильно.

- Обновление весов: каждый вес корректируется в сторону уменьшения ошибки на небольшую величину (шаг обучения, темп обучения).

- Повтор: процесс повторяется для следующего примера или батча данных – снова и снова, итерация за итерацией.

Ключевая идея: сеть не просто «запоминает» правильные ответы – она постепенно перестраивает внутренние веса так, чтобы общий уровень ошибки на всех примерах снижался. Именно поэтому обученная нейросеть может давать правильные ответы на данные, которых раньше не видела.

5 основных алгоритмов обучения нейросетей

Метод обратного распространения ошибки говорит в каком направлении менять веса. Но не говорит, насколько и с какой скоростью. Этим занимаются алгоритмы оптимизации – они управляют процессом обновления весов на каждом шаге. Вот пять ключевых из них.

1. Градиентный спуск (Gradient Descent)

Суть: базовый и исторически первый алгоритм оптимизации нейросетей.

Как работает: представьте, что вы стоите в тумане на холмистом склоне и хотите спуститься в самую низкую точку. Вы не видите весь рельеф, но можете нащупать, в какую сторону уклон сильнее. Делаете шаг туда, где круче вниз, – и повторяете. Именно так работает градиентный спуск: на каждом шаге он вычисляет градиент функции потерь по всем весам и делает шаг в сторону его уменьшения.

Особенность: перед обновлением весов алгоритм обрабатывает весь датасет целиком. Только после этого делается один шаг.

Плюсы: стабильное движение к минимуму, хорошо работает на небольших данных.

Минусы: при большом датасете – катастрофически медленно. Один шаг может потребовать часов вычислений.

Когда применять: учебные задачи, небольшие датасеты, ситуации, когда важна максимальная точность каждого обновления.

2. Стохастический градиентный спуск (SGD)

Суть: ускоренная версия градиентного спуска, которая не ждет обработки всего датасета.

Как работает: вместо того чтобы считать градиент по всей обучающей выборке, SGD берет один случайный пример – и сразу обновляет веса. Потом берет следующий, снова обновляет, и так далее. За одну эпоху сеть делает столько обновлений, сколько примеров в датасете.

Плюсы: в разы быстрее полного градиентного спуска. Случайность помогает «вырваться» из локальных минимумов.

Минусы: обновления нестабильны – функция потерь «прыгает» вверх-вниз, а не плавно снижается. Нужна аккуратная настройка темпа обучения.

Когда применять: большие объемы данных, задачи онлайн-обучения (когда данные поступают потоком), ситуации с ограниченной памятью.

Требуется мощный сервер для обучения нейросетей? Cloud4box — это специализированные серверы для ИИ и машинного обучения на базе графических ускорителей NVIDIA (GPU) и быстрых NVMe-дисков. Круглосуточная поддержка инженеров. Гарантия 100% вычислительной мощности, полный контроль и тонкая настройка. Поможем перенести ваши данные. Мы обеспечиваем бескомпромиссную производительность для тренировки моделей, инференса и обработки больших данных. Полная изоляция ресурсов и выделенные GPU без шейринга. Запускайте ресурсонмкие задачи: обучение LLM, компьютерное зрение, обработку естественного языка, большие данные — без простоев и с предсказуемой скоростью.

3. Мини-батч градиентный спуск (Mini-Batch GD)

Суть: компромисс между полным GD и SGD, который используется в подавляющем большинстве современных нейросетей.

Как работает: датасет делится на небольшие порции – батчи (обычно 32, 64 или 128 примеров). Алгоритм обрабатывает один батч, считает градиент по нему и обновляет веса. Затем берется следующий батч.

Плюсы: стабильнее SGD (ошибка не «скачет» так сильно), быстрее полного GD, хорошо ложится на параллельные вычисления GPU – батч обрабатывается одновременно.

Минусы: нужно подбирать оптимальный размер батча. Слишком маленький – нестабильность SGD. Слишком большой – потеря скорости и риск застрять в локальном минимуме.

Когда применять: стандартный выбор для обучения CNN, RNN, трансформеров и большинства задач глубокого обучения.

4. Адам (Adam – Adaptive Moment Estimation)

Суть: на сегодняшний день самый популярный оптимизатор в практическом машинном обучении.

Как работает: Adam объединяет две идеи. Первая – инерция (Momentum): алгоритм помнит, в каком направлении двигался раньше, и «разгоняется» в ту же сторону. Вторая – адаптивный шаг (RMSProp): для каждого веса подбирается свой индивидуальный темп обучения – параметры с большими градиентами получают меньший шаг, с маленькими – больший. В итоге Adam сам подстраивается под структуру конкретной задачи.

Плюсы: быстрая сходимость, меньше требовательность к ручной настройке темпа обучения, хорошо работает на «разреженных» данных (текст, рекомендательные системы).

Минусы: иногда Adam «переобучается» быстрее SGD – особенно на задачах, где важна обобщающая способность модели.

Когда применять: компьютерное зрение, NLP, генеративные модели, трансформеры – практически везде как стартовый выбор.

5. Метод импульса (Momentum)

Суть: улучшение над стандартным SGD, которое добавляет «инерцию» в процесс обновления весов.

Как работает: аналогия – шар, который катится с горы. Сначала он движется медленно, но со временем набирает скорость в нужном направлении. Если на пути встречается небольшая ямка (локальный минимум), шар не застрянет – инерция протащит его дальше. Momentum именно так «помнит» предыдущие шаги и использует их, чтобы не отклоняться на незначительные колебания градиента.

Плюсы: быстрее сходится, чем чистый SGD, устойчив к шуму в градиенте, помогает преодолевать локальные минимумы.

Минусы: добавляется один гиперпараметр (коэффициент импульса), который тоже нужно настраивать.

Когда применять: часто используется как надстройка над SGD (SGD + Momentum) – особенно при обучении сверточных сетей в задачах классификации изображений.

| Алгоритм | Скорость | Стабильность | Когда применять |

| Градиентный спуск | Низкая | Высокая | Небольшие датасеты, учебные задачи |

| SGD | Высокая | Низкая | Большие данные, онлайн-обучение |

| Mini-Batch GD | Высокая | Средняя | Стандарт для большинства задач |

| Adam | Высокая | Высокая | NLP, CV, генеративные модели |

| Momentum | Средняя | Средняя | Надстройка над SGD, сверточные сети |

💡 Какой оптимизатор чаще всего берут для LLM и диффузионных моделей?

Индустриальный стандарт – AdamW (вариация Adam с корректной L2-регуляризацией). Именно его используют в LLaMA, Stable Diffusion, GPT.

- Почему не SGD? У LLM миллиарды параметров, и ручная настройка скорости обучения для каждого слоя нереальна. Adam сам адаптирует шаг.

- Какое железо? Для Adam нужно больше VRAM, чем для SGD (хранит моменты 1-го и 2-го порядка), поэтому 80 ГБ на карту – обычное дело для 30B+ моделей.

- Альтернатива: Adafactor (экономит память, но чуть хуже сходится).

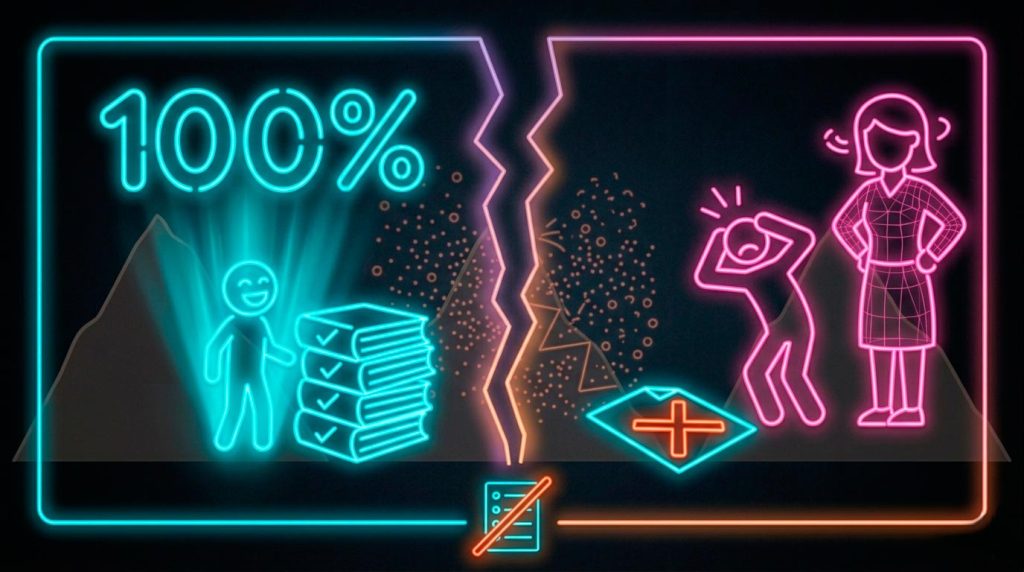

Переобучение: главная проблема и как с ней бороться

Представьте студента, который готовится к экзамену не по темам, а по конкретным билетам прошлых лет. На знакомые вопросы он ответит идеально. Но стоит преподавателю немного изменить формулировку – и студент теряется, потому что не понял материал, а заучил ответы. Нейросеть ведет себя точно так же.

Переобучение (overfitting) – ситуация, когда модель слишком хорошо «запоминает» обучающие данные и теряет способность обобщать. На тренировочной выборке – почти 100% точность. На новых данных – провал.

Это одна из главных практических проблем при работе с нейросетями. Чем сложнее модель и чем меньше данных, тем выше риск.

Основные методы регуляризации

- Dropout. Во время каждой итерации случайным образом «выключается» часть нейронов (обычно 20–50%). Сеть вынуждена не полагаться на одни и те же пути – она учится находить закономерности через разные комбинации нейронов. Результат: модель обобщает, а не запоминает.

- L1 и L2-регуляризация. К функции потерь добавляется штраф за большие значения весов. L2 штрафует за квадрат весов (распределяет важность равномерно), L1 – за их абсолютное значение (обнуляет незначимые веса, создавая «разреженность»). Оба метода не дают сети «раздуть» отдельные веса до огромных значений.

- Ранняя остановка (Early Stopping). В процессе обучения параллельно отслеживается качество модели на валидационной выборке – данных, которые не участвуют в обучении. Как только метрика на валидации перестает улучшаться (или начинает падать), обучение останавливается. Сохраняются веса лучшей точки, а не последней.

- Аугментация данных (Data Augmentation). Если данных мало, их искусственно расширяют: изображения поворачивают, отражают, добавляют шум, меняют яркость. Для текста – перефразируют, меняют синонимы. Модель видит больше разнообразных примеров и меньше «зазубривает» конкретные образцы.

Как выбрать алгоритм обучения: практические советы

Теория без практики – это просто красивые слова. Вот конкретные ориентиры для выбора алгоритма под задачу.

«На практике 80% задач закрывает Adam с дефолтными параметрами. Если результат не устраивает – переходим на SGD с Momentum и ручной настройкой learning rate schedule. Тюнинг оптимизатора имеет смысл только после того, как вы разобрались с данными и архитектурой» – типичная рекомендация ML-инженеров из команд, работающих с production-моделями.

Шпаргалка по выбору:

- Стартуете с нуля, не знаете что выбрать → Adam (lr=1e-3). Меньше головной боли с настройкой.

- Обучаете большую модель на изображениях или тексте → Adam или AdamW (Adam с weight decay).

- Хотите максимальную обобщающую способность, готовы потратить время → SGD + Momentum с cosine learning rate schedule.

- Датасет маленький (до нескольких тысяч примеров) → полный градиентный спуск или Mini-Batch с большим батчем.

- Появилось переобучение → добавьте Dropout (0.3–0.5) и L2-регуляризацию, уменьшите сложность модели или увеличьте датасет через аугментацию.

- Задача обучения с подкреплением → специализированные алгоритмы (PPO, A3C), которые строятся на базе тех же градиентных методов.

Не существует алгоритма, который побеждает всегда. Выбор зависит от типа данных, архитектуры модели и доступных вычислительных ресурсов. Правильный подход – начать с Adam, обучить базовую модель и дальше экспериментировать точечно.

Часто задаваемые вопросы

Это правило, по которому нейросеть корректирует свои внутренние параметры (веса) после каждого примера или группы примеров. Цель – уменьшить ошибку между предсказанием сети и правильным ответом.

При обучении с учителем каждый пример в датасете снабжен правильным ответом (меткой). При обучении без учителя меток нет – сеть сама ищет структуру и закономерности в данных.

Для большинства задач подойдет Adam с темпом обучения 1e-3. Это стандартный стартовый выбор в задачах компьютерного зрения, NLP и работы с табличными данными.

Переобучение – когда модель «заучивает» обучающие данные и плохо работает на новых. Основные способы борьбы: Dropout, L1/L2-регуляризация, ранняя остановка и аугментация данных.