Представьте, что вы открыли магазин в чистом поле, где нет ни дорог, ни указателей. Примерно так чувствует себя сайт, который не проиндексирован поисковиками. Индексация – это процесс добавления страниц вашего ресурса в базу данных Google и Яндекса. Только после этого пользователи смогут найти вас по своим запросам.

Перед индексацией важно правильно выбрать хостинг для сайта. Подробнее об этом читайте в статье: Как выбрать хостинг для WordPress. Без индексации сайт существует только для тех, кто точно знает его адрес. В этом руководстве разберем, как правильно провести сайт через все этапы индексации, ускорить этот процесс и решить типичные проблемы.

Из этого руководства вы узнаете:

- Как устроена индексация.

- Как правильно подготовить сайт.

- Пошаговый алгоритм добавления.

- Как ускорить процесс.

- Что индексировать, а что – нет.

- Как найти и исправить ошибки.

Содержание:

- Что такое индексация сайта и как она работает?

- Подготовка сайта к индексации: 3 обязательных условия

- Как добавить сайт в поисковые системы: пошаговая инструкция

- Создание и отправка карты сайта (sitemap.xml)

- Настройка файла robots.txt для управления индексацией

- Как ускорить индексацию сайта: 5 эффективных способов

- Управление индексацией: что индексировать, а что закрыть

- Диагностика и решение проблем с индексацией

- Особые случаи и продвинутые настройки

- Чек-лист для быстрого старта

Что такое индексация сайта и как она работает?

Индексация сайта – это процесс добавления веб-страниц в базу данных поисковой системы. Простыми словами: поисковик узнает о существовании вашего сайта, изучает его содержимое и сохраняет информацию у себя, чтобы потом показывать пользователям. Работает это так:

- Обнаружение. Поисковый робот (краулер) находит новые страницы: переходит по ссылкам с других сайтов, изучает карту сайта (sitemap) или получает прямую команду от вебмастера.

- Сканирование. Робот загружает страницу, изучает ее код, текст, изображения, метатеги, структуру ссылок.

- Анализ. Система оценивает качество контента, его уникальность, релевантность возможным запросам.

- Добавление в индекс. Если страница проходит первичный отбор, она попадает в базу данных поисковика.

- Ранжирование. Теперь страница может участвовать в выдаче, ее позиции зависят от множества факторов (поведенческие, ссылочные, технические).

У Google и Яндекс есть свои особенности. Google использует принцип Mobile-first: в первую очередь оценивает мобильную версию сайта. Также важен краулинговый бюджет – частота и глубина обхода страниц, которая зависит от авторитетности ресурса. Яндекс пока отдает приоритет десктопной версии, а для ускорения индексации может использовать данные Яндекс.Метрики.

Важно: Индексация ≠ высокие позиции. Попадание в базу поисковика – лишь необходимое условие для участия в выдаче, но никак не гарантия топа. Это только первый шаг на пути к трафику.

Подготовка сайта к индексации: 3 обязательных условия

Прежде чем отправлять сайт на индексацию, убедитесь, что он технически готов к встрече с поисковыми роботами. Проверьте три базовых условия:

- Доступность. Сайт должен открываться 24/7, не быть закрыт паролем или по IP. Хостинг обязан обеспечивать стабильную работу – если сервер часто падает, робот не сможет регулярно проверять новые страницы. Если вы ищете надежный хостинг для сайта, обратите внимание на Cloud4box. Мы предоставляем: UPTIME 99,98%, ЦОД Tier-3, круглосуточную техподдержку и современное оборудование.

- Корректный robots.txt. Файл в корне сайта должен разрешать доступ к важным разделам. Ни в коем случае не закрывайте от индексации CSS и JavaScript – это мешает Google правильно отображать и оценивать страницы.

- Наличие контента. Пустые страницы или страницы с неуникальным текстом поисковики индексируют неохотно. Убедитесь, что на каждой значимой странице есть уникальные заголовки (title, h1), метатеги description и содержательный текст.

Совет: Перед отправкой сайта в поисковые системы проверьте ответ сервера через Яндекс.Вебмастер. В разделе «Инструменты» выберите «Проверка ответа сервера». Если видите код 200 ОК – все в порядке, страница доступна и готова к индексации.

Как добавить сайт в поисковые системы: пошаговая инструкция

Чтобы сообщить поисковикам о своем ресурсе, нужно пройти простую регистрацию в официальных инструментах для вебмастеров. Это не гарантирует мгновенной индексации, но значительно ускоряет процесс и открывает доступ к статистике.

Регистрация в Яндекс.Вебмастер

- Перейдите на сайт webmaster.yandex.ru и авторизуйтесь через аккаунт Яндекса.

- Нажмите кнопку «Добавить сайт» и введите полный адрес вашего ресурса (например,

https://vash-sait.ru). - Подтвердите права на сайт. Самый надежный способ – через DNS-запись: добавьте TXT-запись в настройках домена у хостинг-провайдера. Это подтверждает права на всех поддоменах раз и навсегда.

- После подтверждения добавьте счетчик Яндекс.Метрики и привяжите его к сайту в разделе «Настройки» → «Привязка к Метрике». Это позволит роботу учитывать поведенческие факторы и быстрее обнаруживать новые страницы.

Регистрация в Google Search Console

- Откройте search.google.com/search-console и войдите в аккаунт Google.

- Выберите тип ресурса: «Домен» (рекомендуется, включает все поддомены и протоколы) или «Префикс URL» (только конкретный адрес).

- Введите адрес сайта и нажмите «Продолжить».

- Подтвердите права. Для домена – через DNS-запись (аналогично Яндексу). Для префикса – можно загрузить HTML-файл в корень сайта или добавить метатег в код главной страницы.

- После подтверждения изучите основные разделы: «Покрытие» (статус индексации), «Производительность» (поисковые запросы), «Проверка URL» (ручная отправка на индексацию).

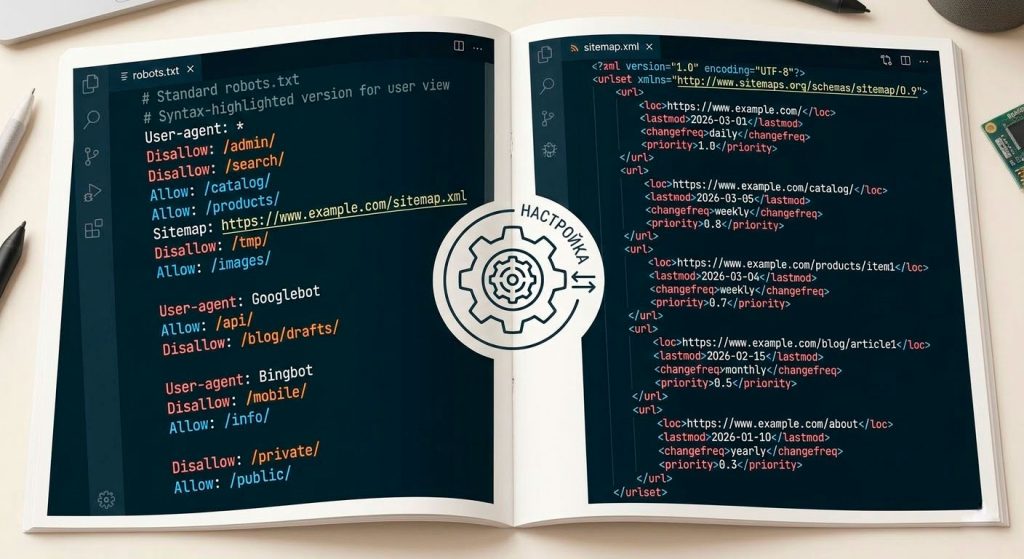

Создание и отправка карты сайта (sitemap.xml)

Файл sitemap.xml – это карта вашего сайта для поисковых роботов. В нем перечислены все значимые страницы, которые вы хотите видеть в индексе, с указанием даты последнего обновления, частоты изменений и приоритета. Робот изучает этот файл в первую очередь, чтобы понять структуру ресурса и не пропустить важные разделы.

Как создать карту сайта:

- Для сайтов на WordPress используйте SEO-плагины: AIOSEO, Yoast SEO или Rank Math. Они генерируют sitemap автоматически и обновляют ее при публикации новых материалов.

- Для простых сайтов без CMS подойдут онлайн-генераторы (например, mysitemapgenerator.com). Загрузите список страниц или укажите главный URL, и сервис создаст файл.

- Для сложных проектов с динамическим контентом (интернет-магазины, порталы) лучше настроить динамическую генерацию sitemap через CMS или фреймворк – так карта всегда будет актуальной без ручного вмешательства.

Как добавить sitemap в поисковые системы:

- Через Яндекс.Вебмастер: раздел «Индексирование» → «Файлы Sitemap» → «Добавить файл». Укажите путь к sitemap.xml.

- Через Google Search Console: раздел «Индексирование» → «Карты сайта» → «Добавьте карту сайта».

- Пропишите директиву Sitemap прямо в файле robots.txt:

Sitemap: https://vash-sait.ru/sitemap.xml. Это универсальный способ, который подскажет роботам путь к карте даже без панелей вебмастера.

Совет: Включайте в sitemap только страницы, которые действительно должны быть в поиске. Исключите служебные разделы (админка, корзина, результаты поиска), дубли, страницы с тегами и временными параметрами. Иначе робот потратит краулинговый бюджет на второстепенный контент.

Настройка файла robots.txt для управления индексацией

Robots.txt – это текстовый файл с инструкциями для поисковых роботов. Он лежит в корневой папке сайта (например, vash-sait.ru/robots.txt) и сообщает краулерам, какие разделы можно сканировать, а какие – запрещены.

Основные директивы:

| Директива | Описание |

| User-agent | Указывает, для какого робота действуют правила (* – для всех) |

| Disallow | Запрещает доступ к указанным разделам или страницам |

| Allow | Разрешает доступ (используется для уточнения внутри запрещенных папок) |

| Crawl-delay | Задает задержку между запросами робота (в секундах) для снижения нагрузки на сервер |

Пример базового robots.txt для нового сайта:

User-agent: *

Disallow: /admin/

Disallow: /search/

Disallow: /personal/

Sitemap: https://vash-sait.ru/sitemap.xml

Проверить robots.txt на ошибки можно прямо в Яндекс.Вебмастере: раздел «Инструменты» → «Анализ robots.txt». Загрузите файл или вставьте его содержимое – сервис покажет все проблемы и даст рекомендации по исправлению. В Google Search Console аналогичная функция доступна в отчете о покрытии.

Как ускорить индексацию сайта: 5 эффективных способов

Даже если сайт добавлен в панели вебмастеров, индексация новых страниц может занять от нескольких дней до нескольких недель. Чтобы ускорить этот процесс, используйте пять проверенных методов.

1. Ручной запрос через инструменты вебмастеров

Самый прямой способ – вручную сообщить поисковику о новой странице:

- Google Search Console: откройте «Проверка URL», введите адрес страницы, дождитесь проверки и нажмите «Запросить индексирование».

- Яндекс.Вебмастер: раздел «Индексирование» → «Переобход страниц», вставьте URL и отправьте запрос.

Лимиты: индивидуально, зависит от возраста и авторитетности ресурса.

2. Внутренняя перелинковка

Разместите ссылки на новую страницу с уже проиндексированных разделов – главной, популярных статей, категорий. Чем больше ссылок, тем быстрее робот обнаружит материал. Особенно эффективны контекстные ссылки из старого контента: добавьте в релевантную статью абзац со ссылкой на новую публикацию.

3. Обновление и повторная отправка sitemap

После добавления новых страниц обязательно обновите файл sitemap.xml (в CMS это происходит автоматически). Затем повторно отправьте его в панелях вебмастеров – это сигнал для робота, что появился свежий контент.

4. Протокол IndexNow

IndexNow – открытый протокол, который позволяет мгновенно уведомлять поисковики об изменениях на сайте. Поддерживается Яндексом, Bing, но не Google. При публикации страницы ваш сайт отправляет простой ping-запрос, и робот сразу начинает обход. Подключить можно через CMS-плагины (например, Rank Math для WordPress) или через API, добавив несколько строк кода.

5. Внешние ссылки (бэклинки)

Ссылки с других сайтов – мощный катализатор индексации. Робот, обходя авторитетный ресурс, переходит по ссылке на ваш сайт и обнаруживает новые страницы. Публикуйте анонсы в профессиональных сообществах, соцсетях, на тематических форумах. Даже один качественный бэклинк с активного сайта может запустить мгновенную индексацию.

Лайфхак: Комбинация внутренней перелинковки + ручного запроса через Search Console сокращает время индексации с 2-3 недель до 2-3 дней. Разместите 2-3 ссылки на новую страницу со старых материалов и сразу отправьте ее на переобход.

Управление индексацией: что индексировать, а что закрыть

Не все страницы сайта должны попадать в поисковую выдачу. Грамотное управление индексацией помогает сфокусировать краулинговый бюджет на действительно важных разделах и избежать санкций за дублированный или технический контент.

| Что индексировать | Что закрыть от индексации |

| Главная страница | Административная панель (/admin/) |

| Категории и разделы | Страница поиска по сайту (/search/) |

| Карточки товаров | Корзина и оформление заказа (/cart/, /checkout/) |

| Статьи блога | Страницы регистрации и входа (/login/, /register/) |

| Страницы «О нас», «Контакты» | Дубли с UTM-метками, параметрами сортировки |

| Полезные информационные материалы | Версии для печати, пустые категории, страницы с ошибкой 404 |

Какие страницы нужно индексировать в первую очередь

В первую очередь в индекс должны попадать страницы, которые приносят трафик и формируют доверие: главная, рубрики каталога, карточки товаров или услуг, полезные статьи блога, контактная информация и раздел «О компании». Именно эти URL пользователи будут вводить в поиске.

Какие страницы лучше закрыть от индексации

- Служебные разделы: админка, панели управления, страницы входа и регистрации, корзина, личный кабинет. Пользователю не нужно находить их через поиск.

- Дубли: страницы с параметрами сессий, сортировки, фильтрации, UTM-метками. Они создают копии основного контента и могут расцениваться как неуникальные.

- Технические страницы: результаты поиска по сайту, пустые категории, страницы с кодом 404 – они не несут ценности для посетителя.

Как закрыть страницу от индексации: 4 способа

- Метатег noindex – добавьте в

<head>страницы:<meta name="robots" content="noindex">

Робот проиндексирует URL, но не покажет его в выдаче. - Директива Disallow в robots.txt – запрещает сканирование:

Disallow: /admin/

Важно: страница все еще может появиться в поиске, если на нее ведут внешние ссылки. - X-Robots-Tag на уровне сервера – настройте HTTP-заголовок для определенных типов файлов или URL:

X-Robots-Tag: noindex - Авторизация – закройте раздел паролем. Робот не сможет пройти дальше страницы входа.

Диагностика и решение проблем с индексацией

Даже при правильной настройке часть страниц может не попадать в индекс или выпадать из него. Регулярная диагностика помогает быстро выявить и устранить проблемы.

Как проверить, проиндексирована ли страница

- Оператор site: введите в Google или Яндексе

site:вашсайт.ru/адрес-страницы. Если страница есть в выдаче – она проиндексирована. - Инструмент «Проверка URL» в Google Search Console и Яндекс.Вебмастере покажет точный статус, дату последнего сканирования и причины возможных ошибок.

- Разделы отчетов: в Search Console – «Покрытие», в Вебмастере – «Индексирование» → «Страницы в поиске» и «Исключенные страницы». Там видны все проиндексированные и отклоненные URL с пояснениями.

Чек-лист: почему страница не индексируется

- Статус ответа сервера – должен быть 200 ОК. Проверьте через «Проверку URL» или браузер.

- Метатег noindex – посмотрите исходный код страницы, нет ли <meta name=»robots» content=»noindex»>.

- X-Robots-Tag – возможно, заголовок сервера запрещает индексацию.

- robots.txt – убедитесь, что страница не заблокирована директивой Disallow.

- Sitemap.xml – включен ли URL в карту сайта и отправлена ли она в поисковики.

- Внутренние ссылки – есть ли хотя бы одна ссылка на эту страницу с других разделов сайта.

- Канонический тег – rel=»canonical» должен указывать на саму страницу, а не на дубль.

- Качество контента – уникален ли текст, нет ли признаков дублирования или тонкого контента.

Коды ответа сервера: что означают

| Код | Значение | Действие |

| 200 OK | Страница доступна, все в порядке | Можно индексировать |

| 301 Moved Permanently | Страница навсегда перемещена на новый адрес | Проверьте цепочку редиректов |

| 404 Not Found | Страница удалена или никогда не существовала | Верните контент или настройте 301 |

| 503 Service Unavailable | Сервер временно недоступен | Робот вернется позже, проверьте хостинг |

Особые случаи и продвинутые настройки

Индексация после редизайна или смены домена

При переезде на новый домен или изменении структуры URL главное – сохранить уже накопленный индекс. Настройте 301 редиректы со старых адресов на новые для каждой страницы. Обновите sitemap.xml и robots.txt, укажите актуальные адреса. В Яндекс.Вебмастере используйте инструмент «Переезд сайта» – он официально уведомит поисковик о смене зеркала. В Google Search Console добавьте новый сайт и укажите в настройках старого, что адрес изменился.

Работа с дублями и зеркалами

Дубли – страницы с идентичным или очень похожим содержанием (например, товар в двух категориях). Они распыляют краулинговый бюджет и могут привести к фильтрам. Бороться с ними помогает:

- rel=»canonical» – укажите главную версию страницы;

- 301 редирект – если дубль не нужен, перенаправьте его на основной URL;

- clean-param в robots.txt – для игнорирования параметров сессий и сортировки.

Зеркала (www/без www, http/https) склеиваются через 301 редирект и директиву Host в robots.txt.

Индексация сайтов на CMS (WordPress, 1С-Битрикс)

Популярные CMS создают дубли автоматически: в WordPress – это страницы тегов, архивов по датам, пагинация; в Битрикс – множественные параметры фильтров и сортировок. Решение – SEO-плагины (Yoast, Rank Math для WordPress, модуль «Поисковая оптимизация» в Битрикс). Они закрывают дубли от индексации, настраивают canonical и корректно генерируют sitemap.

Чек-лист для быстрого старта

- Добавьте сайт в Яндекс.Вебмастер и Google Search Console, подтвердите права.

- Проверьте файл robots.txt и создайте актуальный sitemap.xml.

- Настройте внутреннюю перелинковку – ссылайтесь на новые страницы со старых.

- Отправьте ключевые URL на ручной переобход в панелях вебмастеров.

- Регулярно просматривайте отчеты об ошибках и исключенных страницах.

Индексация – это не разовое действие, а постоянный процесс. Следите за своим сайтом, оперативно исправляйте технические проблемы, и поисковики ответят вам стабильным трафиком.

Часто задаваемые вопросы

Обычно от нескольких дней до нескольких недель. Первые страницы могут появиться в Google за 3–7 дней, Яндекс часто работает медленнее, особенно с молодыми ресурсами.

Нет, если на сайте настроена внутренняя перелинковка и sitemap.xml автоматически обновляется. Ручной запрос нужен только для критически важных материалов, которые должны попасть в выдачу за 1–2 дня.

Да, напрямую. Медленный сервер или частые ошибки 5xx заставляют робота прерывать обход и возвращаться позже, что увеличивает время индексации. Стабильный хостинг с быстрым откликом – база для успешного SEO.